奶奶打电话来救我。 AI改变假孙子的声音来设置

发布时间:2025-10-30 09:51

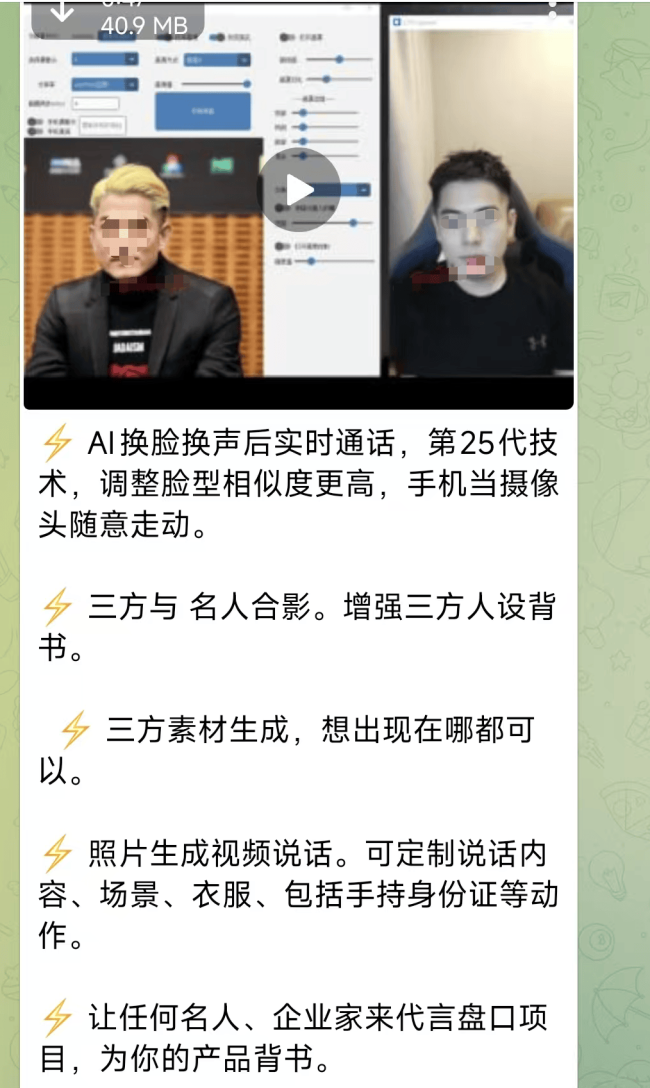

奶奶打电话来救我。 AI改变假孙子的声音来设置陷阱。诈骗目标是养老金! “奶奶,我不小心撞到了人,请不要告诉我的父母,请救救我!”当听到电话那头“孙子”的声音时,来自湖南的刘奶奶慌了。他立即按照对方的指示,去银行提取了3万元现金。按照协议,他把钱交给了村口的“所长亲戚”。奶奶打电话来救我。 AI改变假孙子的声音来设置陷阱。诈骗目标是养老金!这只是“人工智能作弊”的又一个例子。在这个数字时代,人工智能技术就像一把双刃剑。这在给老年人带来安慰和改变的同时,也给老年人带来了新的危险。在语音、视频宽恕的技术门槛大幅降低的同时,一些黑灰行业从业者也开始意识到,针对老年人不熟悉新技术、获取信息有限、情感上容易依赖亲人的弱点,开展了“狩猎”行动。调查发现,这些诈骗主要依靠AI深度宽恕技术。人工智能针对老人的“陷阱”主要包括冒充老人亲属、子女诈骗钱财、去掉医生、专家身份通过直播推销商品等。他们通过精心制作虚假宣传视频和山寨产品,最大限度地发挥mga产品的功效,甚至编造一些虚构的“治愈案例”来说服长辈。多平台搜索发现,不少人在“包装出售”换脸/克隆语音,价格在1元以下,一定程度上降低了诈骗门槛。海外平台黑灰行业从业者也提供从变声到变变的“一站式服务”,机智h价格从十几元到百元不等。北京盈科(合肥)律师事务所合伙人蒋万东表示,随着人工智能技术日趋成熟,换脸不再困难,甚至成为一种新的商业模式。不过,在使用人工智能进行脸部修饰时,应严格遵守法律法规。未经许可使用他人照片、声音素材进行换脸、变声,提供在线换脸、变声服务并收取费用,利用人工智能合成、换脸视频介绍有权人等。

奶奶打电话来救我。 AI改变假孙子的声音来设置陷阱。诈骗目标是养老金! “奶奶,我不小心撞到了人,请不要告诉我的父母,请救救我!”当听到电话那头“孙子”的声音时,来自湖南的刘奶奶慌了。他立即按照对方的指示,去银行提取了3万元现金。按照协议,他把钱交给了村口的“所长亲戚”。奶奶打电话来救我。 AI改变假孙子的声音来设置陷阱。诈骗目标是养老金!这只是“人工智能作弊”的又一个例子。在这个数字时代,人工智能技术就像一把双刃剑。这在给老年人带来安慰和改变的同时,也给老年人带来了新的危险。在语音、视频宽恕的技术门槛大幅降低的同时,一些黑灰行业从业者也开始意识到,针对老年人不熟悉新技术、获取信息有限、情感上容易依赖亲人的弱点,开展了“狩猎”行动。调查发现,这些诈骗主要依靠AI深度宽恕技术。人工智能针对老人的“陷阱”主要包括冒充老人亲属、子女诈骗钱财、去掉医生、专家身份通过直播推销商品等。他们通过精心制作虚假宣传视频和山寨产品,最大限度地发挥mga产品的功效,甚至编造一些虚构的“治愈案例”来说服长辈。多平台搜索发现,不少人在“包装出售”换脸/克隆语音,价格在1元以下,一定程度上降低了诈骗门槛。海外平台黑灰行业从业者也提供从变声到变变的“一站式服务”,机智h价格从十几元到百元不等。北京盈科(合肥)律师事务所合伙人蒋万东表示,随着人工智能技术日趋成熟,换脸不再困难,甚至成为一种新的商业模式。不过,在使用人工智能进行脸部修饰时,应严格遵守法律法规。未经许可使用他人照片、声音素材进行换脸、变声,提供在线换脸、变声服务并收取费用,利用人工智能合成、换脸视频介绍有权人等。 下一篇:没有了